时间:2023-05-18 10:52

人气:

作者:admin

我们公司有个项目的数据量高达五千万,但是因为报表那块数据不太准确,业务库和报表库又是跨库操作,所以并不能使用 SQL 来进行同步。当时的打算是通过mysqldump或者存储的方式来进行同步,但是尝试后发现这些方案都不切实际:

mysqldump:不仅备份需要时间,同步也需要时间,而且在备份的过程,可能还会有数据产出(也就是说同步等于没同步)

存储方式:这个效率太慢了,要是数据量少还好,我们使用这个方式的时候,三个小时才同步两千条数据…

后面在网上查看后,发现 DataX 这个工具用来同步不仅速度快,而且同步的数据量基本上也相差无几。

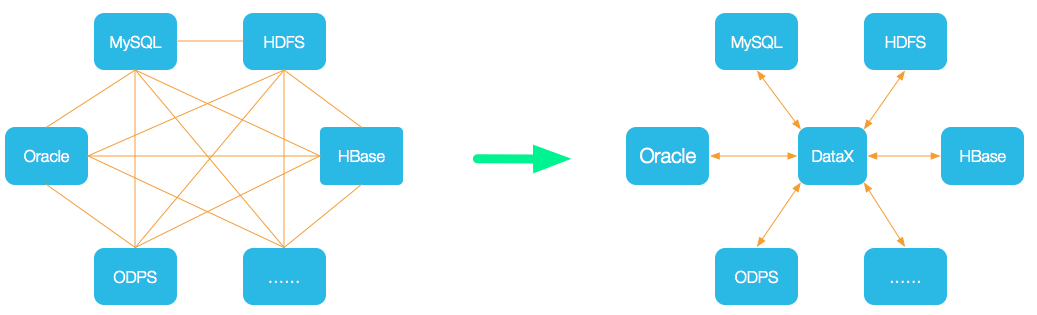

DataX 是阿里云 DataWorks 数据集成 的开源版本,主要就是用于实现数据间的离线同步。DataX 致力于实现包括关系型数据库(MySQL、Oracle 等)、HDFS、Hive、ODPS、HBase、FTP 等各种异构数据源(即不同的数据库)间稳定高效的数据同步功能。

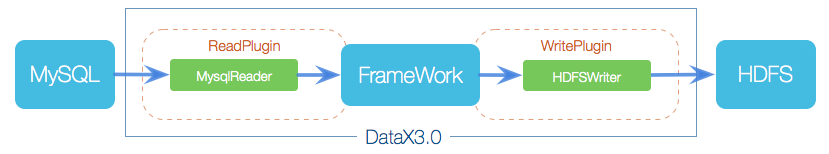

DataX 采用 Framework + Plugin 架构,将数据源读取和写入抽象称为 Reader/Writer 插件,纳入到整个同步框架中。

| 角色 | 作用 |

|---|---|

| Reader(采集模块) |

负责采集数据源的数据,将数据发送给Framework。 |

| Writer(写入模块) |

负责不断向Framework中取数据,并将数据写入到目的端。 |

| Framework(中间商) |

负责连接Reader和Writer,作为两者的数据传输通道,并处理缓冲,流控,并发,数据转换等核心技术问题。 |

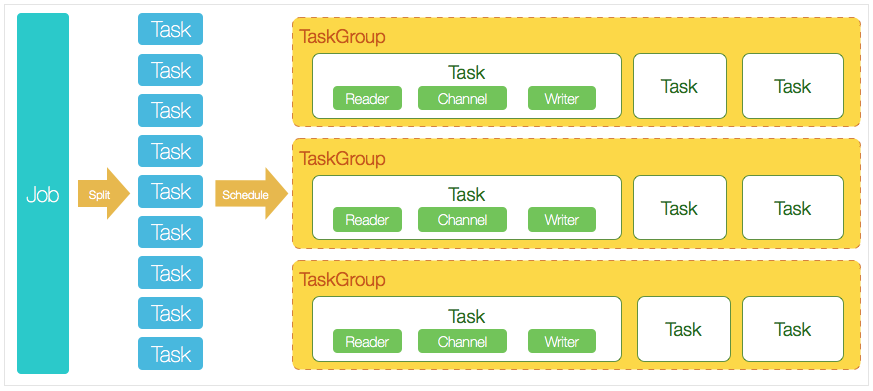

DataX 完成单个数据同步的作业,我们称为 Job,DataX 接收到一个 Job 后,将启动一个进程来完成整个作业同步过程。DataX Job 模块是单个作业的中枢管理节点,承担了数据清理、子任务切分、TaskGroup 管理等功能。

-->Channel-->Writer 线程来完成任务同步工作。DataX 调度过程:

Task / Channel = TaskGroup,最后由 TaskGroup 根据分配好的并发数来运行 Task(任务)准备工作:

tar包方式不需要安装)| 主机名 | 操作系统 | IP 地址 | 软件包 |

|---|---|---|---|

| MySQL-1 | CentOS 7.4 | 192.168.1.1 |

jdk-8u181-linux-x64.tar.gzdatax.tar.gz |

| MySQL-2 | CentOS 7.4 | 192.168.1.2 |

安装 JDK:

下载地址:https://www.oracle.com/java/technologies/javase/javase8-archive-downloads.html(需要创建 Oracle 账号)

[root@MySQL-1~]#ls

anaconda-ks.cfgjdk-8u181-linux-x64.tar.gz

[root@MySQL-1~]#tarzxfjdk-8u181-linux-x64.tar.gz

[root@DataX~]#ls

anaconda-ks.cfgjdk1.8.0_181jdk-8u181-linux-x64.tar.gz

[root@MySQL-1~]#mvjdk1.8.0_181/usr/local/java

[root@MySQL-1~]#cat<>/etc/profile

exportJAVA_HOME=/usr/local/java

exportPATH=$PATH:"$JAVA_HOME/bin"

END

[root@MySQL-1~]#source/etc/profile

[root@MySQL-1~]#java-version

CentOS 7上自带Python 2.7的软件包,所以不需要进行安装。

[root@MySQL-1~]#wgethttp://datax-opensource.oss-cn-hangzhou.aliyuncs.com/datax.tar.gz

[root@MySQL-1~]#tarzxfdatax.tar.gz-C/usr/local/

[root@MySQL-1~]#rm-rf/usr/local/datax/plugin/*/._*#需要删除隐藏文件(重要)

[/usr/local/datax/plugin/reader/._drdsreader/plugin.json] 不存在. 请检查您的配置文件.验证:

[root@MySQL-1~]#cd/usr/local/datax/bin

[root@MySQL-1~]#pythondatax.py../job/job.json#用来验证是否安装成功

输出:

2021-12-131928.828[job-0]INFOJobContainer-PerfTracenotenable!

2021-12-131928.829[job-0]INFOStandAloneJobContainerCommunicator-Total100000records,2600000bytes|Speed253.91KB/s,10000records/s|Error0records,0bytes|AllTaskWaitWriterTime0.060s|AllTaskWaitReaderTime0.068s|Percentage100.00%

2021-12-131928.829[job-0]INFOJobContainer-

任务启动时刻:2021-12-131918

任务结束时刻:2021-12-131928

任务总计耗时:10s

任务平均流量:253.91KB/s

记录写入速度:10000rec/s

读出记录总数:100000

读写失败总数:0

查看streamreader --> streamwriter的模板:

[root@MySQL-1~]#python/usr/local/datax/bin/datax.py-rstreamreader-wstreamwriter

输出:

DataX(DATAX-OPENSOURCE-3.0),FromAlibaba!

Copyright(C)2010-2017,AlibabaGroup.AllRightsReserved.

Pleaserefertothestreamreaderdocument:

https://github.com/alibaba/DataX/blob/master/streamreader/doc/streamreader.md

Pleaserefertothestreamwriterdocument:

https://github.com/alibaba/DataX/blob/master/streamwriter/doc/streamwriter.md

Pleasesavethefollowingconfigurationasajsonfileanduse

python{DATAX_HOME}/bin/datax.py{JSON_FILE_NAME}.json

torunthejob.

{

"job":{

"content":[

{

"reader":{

"name":"streamreader",

"parameter":{

"column":[],

"sliceRecordCount":""

}

},

"writer":{

"name":"streamwriter",

"parameter":{

"encoding":"",

"print":true

}

}

}

],

"setting":{

"speed":{

"channel":""

}

}

}

}

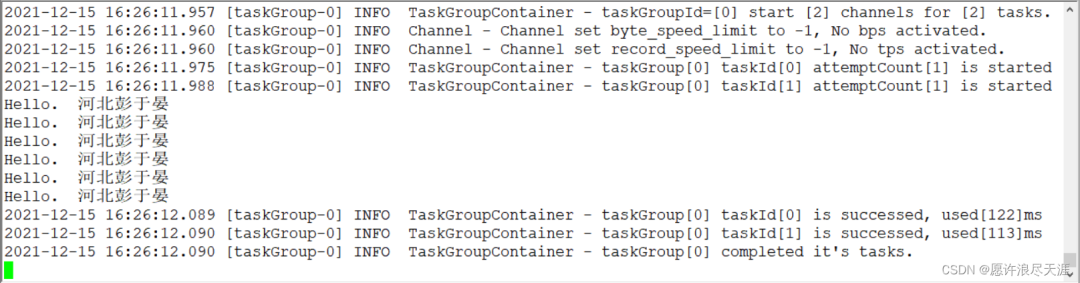

根据模板编写json文件

[root@MySQL-1~]#cat<test.json

{

"job":{

"content":[

{

"reader":{

"name":"streamreader",

"parameter":{

"column":[#同步的列名(*表示所有)

{

"type":"string",

"value":"Hello."

},

{

"type":"string",

"value":"河北彭于晏"

},

],

"sliceRecordCount":"3"#打印数量

}

},

"writer":{

"name":"streamwriter",

"parameter":{

"encoding":"utf-8",#编码

"print":true

}

}

}

],

"setting":{

"speed":{

"channel":"2"#并发(即sliceRecordCount*channel=结果)

}

}

}

}

输出:(要是复制我上面的话,需要把#带的内容去掉)

分别在两台主机上安装:

[root@MySQL-1~]#yum-yinstallmariadbmariadb-servermariadb-libsmariadb-devel

[root@MySQL-1~]#systemctlstartmariadb#安装MariaDB数据库

[root@MySQL-1~]#mysql_secure_installation#初始化

NOTE:RUNNINGALLPARTSOFTHISSCRIPTISRECOMMENDEDFORALLMariaDB

SERVERSINPRODUCTIONUSE!PLEASEREADEACHSTEPCAREFULLY!

Entercurrentpasswordforroot(enterfornone):#直接回车

OK,successfullyusedpassword,movingon...

Setrootpassword?[Y/n]y#配置root密码

Newpassword:

Re-enternewpassword:

Passwordupdatedsuccessfully!

Reloadingprivilegetables..

...Success!

Removeanonymoususers?[Y/n]y#移除匿名用户

...skipping.

Disallowrootloginremotely?[Y/n]n#允许root远程登录

...skipping.

Removetestdatabaseandaccesstoit?[Y/n]y#移除测试数据库

...skipping.

Reloadprivilegetablesnow?[Y/n]y#重新加载表

...Success!

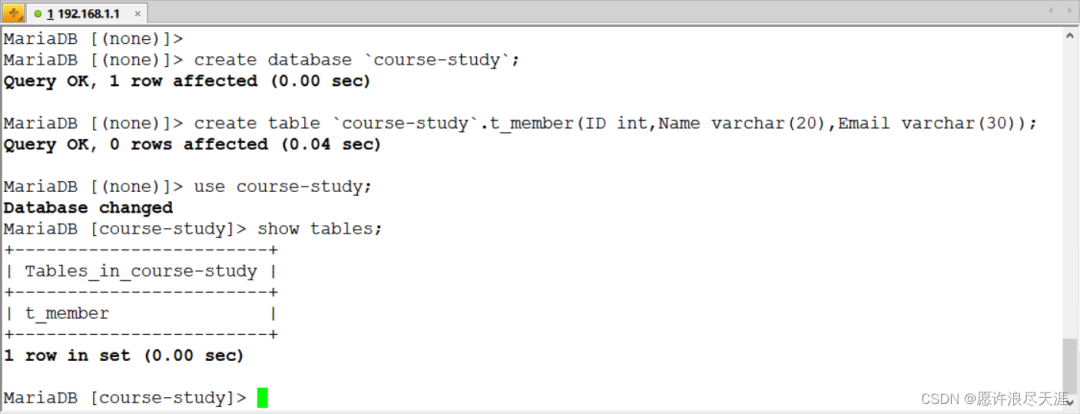

1)准备同步数据(要同步的两台主机都要有这个表)

MariaDB[(none)]>createdatabase`course-study`;

QueryOK,1rowaffected(0.00sec)

MariaDB[(none)]>createtable`course-study`.t_member(IDint,Namevarchar(20),Emailvarchar(30));

QueryOK,0rowsaffected(0.00sec)

因为是使用 DataX 程序进行同步的,所以需要在双方的数据库上开放权限:

grantallprivilegeson*.*toroot@'%'identifiedby'123123';

flushprivileges;

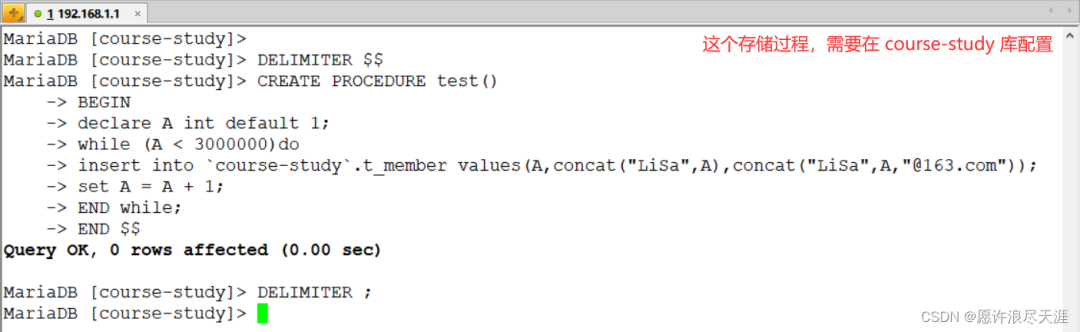

2)创建存储过程:

DELIMITER$$

CREATEPROCEDUREtest()

BEGIN

declareAintdefault1;

while(A< 3000000)do

insertinto`course-study`.t_membervalues(A,concat("LiSa",A),concat("LiSa",A,"@163.com"));

setA=A+1;

ENDwhile;

END$$

DELIMITER;

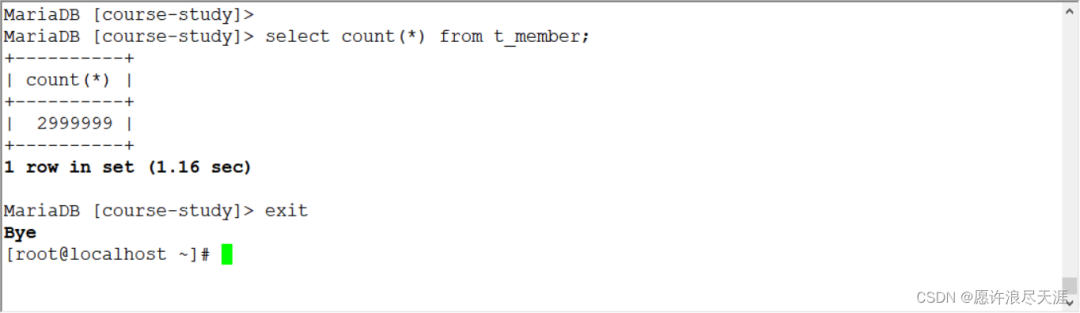

3)调用存储过程(在数据源配置,验证同步使用):

calltest();

1)生成 MySQL 到 MySQL 同步的模板:

[root@MySQL-1~]#python/usr/local/datax/bin/datax.py-rmysqlreader-wmysqlwriter

{

"job":{

"content":[

{

"reader":{

"name":"mysqlreader",#读取端

"parameter":{

"column":[],#需要同步的列(*表示所有的列)

"connection":[

{

"jdbcUrl":[],#连接信息

"table":[]#连接表

}

],

"password":"",#连接用户

"username":"",#连接密码

"where":""#描述筛选条件

}

},

"writer":{

"name":"mysqlwriter",#写入端

"parameter":{

"column":[],#需要同步的列

"connection":[

{

"jdbcUrl":"",#连接信息

"table":[]#连接表

}

],

"password":"",#连接密码

"preSql":[],#同步前.要做的事

"session":[],

"username":"",#连接用户

"writeMode":""#操作类型

}

}

}

],

"setting":{

"speed":{

"channel":""#指定并发数

}

}

}

}

2)编写json文件:

[root@MySQL-1~]#viminstall.json

{

"job":{

"content":[

{

"reader":{

"name":"mysqlreader",

"parameter":{

"username":"root",

"password":"123123",

"column":["*"],

"splitPk":"ID",

"connection":[

{

"jdbcUrl":[

"jdbc//192.168.1.1:3306/course-study?useUnicode=true&characterEncoding=utf8"

],

"table":["t_member"]

}

]

}

},

"writer":{

"name":"mysqlwriter",

"parameter":{

"column":["*"],

"connection":[

{

"jdbcUrl":"jdbc//192.168.1.2:3306/course-study?useUnicode=true&characterEncoding=utf8",

"table":["t_member"]

}

],

"password":"123123",

"preSql":[

"truncatet_member"

],

"session":[

"setsessionsql_mode='ANSI'"

],

"username":"root",

"writeMode":"insert"

}

}

}

],

"setting":{

"speed":{

"channel":"5"

}

}

}

}

3)验证

[root@MySQL-1~]#python/usr/local/datax/bin/datax.pyinstall.json

输出:

2021-12-151615.120[job-0]INFOJobContainer-PerfTracenotenable!

2021-12-151615.120[job-0]INFOStandAloneJobContainerCommunicator-Total2999999records,107666651bytes|Speed2.57MB/s,74999records/s|Error0records,0bytes|AllTaskWaitWriterTime82.173s|AllTaskWaitReaderTime75.722s|Percentage100.00%

2021-12-151615.124[job-0]INFOJobContainer-

任务启动时刻:2021-12-151632

任务结束时刻:2021-12-151615

任务总计耗时:42s

任务平均流量:2.57MB/s

记录写入速度:74999rec/s

读出记录总数:2999999

读写失败总数:0

你们可以在目的数据库进行查看,是否同步完成。

使用 DataX 进行全量同步和增量同步的唯一区别就是:增量同步需要使用where进行条件筛选。(即,同步筛选后的 SQL)

1)编写json文件:

[root@MySQL-1~]#vimwhere.json

{

"job":{

"content":[

{

"reader":{

"name":"mysqlreader",

"parameter":{

"username":"root",

"password":"123123",

"column":["*"],

"splitPk":"ID",

"where":"ID<= 1888",

"connection":[

{

"jdbcUrl":[

"jdbc//192.168.1.1:3306/course-study?useUnicode=true&characterEncoding=utf8"

],

"table":["t_member"]

}

]

}

},

"writer":{

"name":"mysqlwriter",

"parameter":{

"column":["*"],

"connection":[

{

"jdbcUrl":"jdbc//192.168.1.2:3306/course-study?useUnicode=true&characterEncoding=utf8",

"table":["t_member"]

}

],

"password":"123123",

"preSql":[

"truncatet_member"

],

"session":[

"setsessionsql_mode='ANSI'"

],

"username":"root",

"writeMode":"insert"

}

}

}

],

"setting":{

"speed":{

"channel":"5"

}

}

}

}

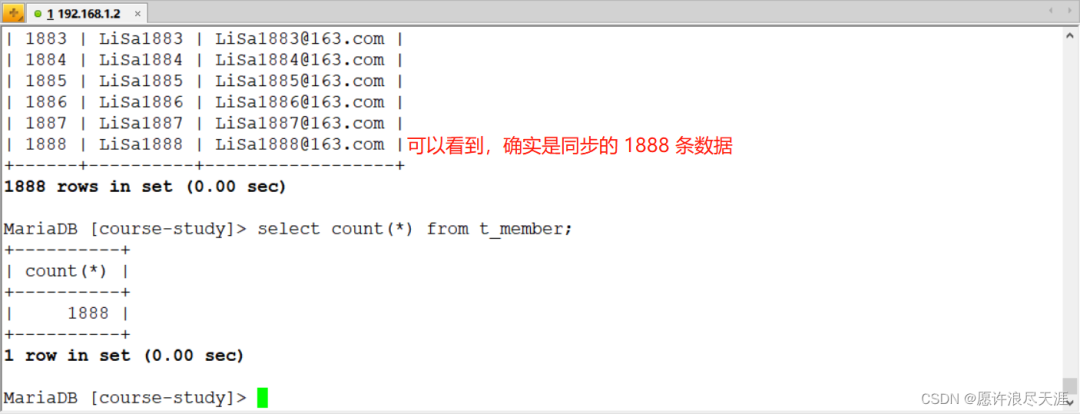

where(条件筛选) 和preSql(同步前,要做的事) 参数。2)验证:

[root@MySQL-1~]#python/usr/local/data/bin/data.pywhere.json

输出:

2021-12-161738.534[job-0]INFOJobContainer-PerfTracenotenable!

2021-12-161738.534[job-0]INFOStandAloneJobContainerCommunicator-Total1888records,49543bytes|Speed1.61KB/s,62records/s|Error0records,0bytes|AllTaskWaitWriterTime0.002s|AllTaskWaitReaderTime100.570s|Percentage100.00%

2021-12-161738.537[job-0]INFOJobContainer-

任务启动时刻:2021-12-161706

任务结束时刻:2021-12-161738

任务总计耗时:32s

任务平均流量:1.61KB/s

记录写入速度:62rec/s

读出记录总数:1888

读写失败总数:0

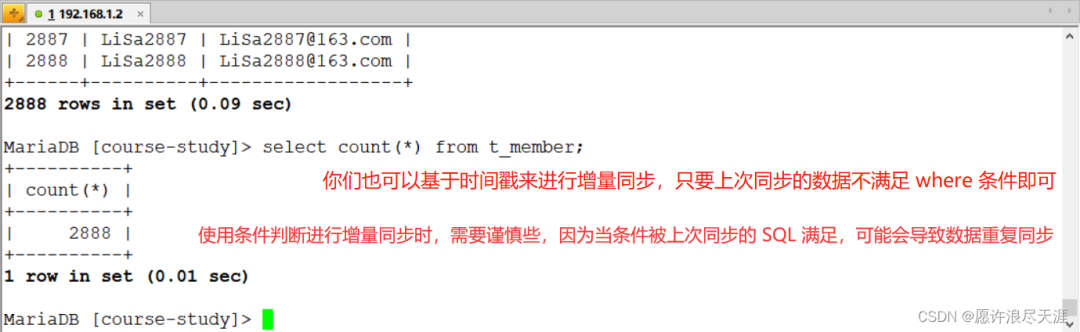

目标数据库上查看:

3)基于上面数据,再次进行增量同步:

主要是where配置:"where":"ID>1888ANDID<= 2888"#通过条件筛选来进行增量同步

同时需要将我上面的preSql删除(因为我上面做的操作时truncate表)

审核编辑 :李倩

上一篇:如何说服技术老大用Redis?