时间:2023-07-06 16:36

人气:

作者:admin

今年3月末,我们在arXiv网站发布了大语言模型综述文章《A Survey of Large Language Models》的第一个版本V1,该综述文章系统性地梳理了大语言模型的研究进展与核心技术,讨论了大量的相关工作。自大语言模型综述的预印本上线以来,受到了广泛关注,收到了不少读者的宝贵意见。

在发布V1版本后的3个月时间内,为了提升该综述的质量,我们在持续更新相关的内容,连续进行了多版的内容修订(版本号目前迭代到V11),论文篇幅从V1版本的51页、416篇参考文献扩增到了V11版本的85页、610篇参考文献。V11版本是我们自五月中下旬开始策划进行大修的版本,详细更新日志请见文章结尾,已于6月末再次发布于arXiv网站。相较于V1版本,V11版本的大语言模型综述有以下新亮点:

在发布V1版本后的3个月时间内,为了提升该综述的质量,我们在持续更新相关的内容,连续进行了多版的内容修订(版本号目前迭代到V11),论文篇幅从V1版本的51页、416篇参考文献扩增到了V11版本的85页、610篇参考文献。V11版本是我们自五月中下旬开始策划进行大修的版本,详细更新日志请见文章结尾,已于6月末再次发布于arXiv网站。相较于V1版本,V11版本的大语言模型综述有以下新亮点:

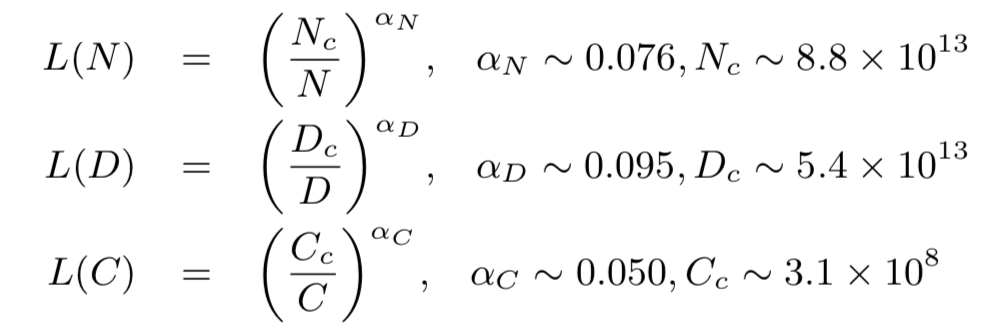

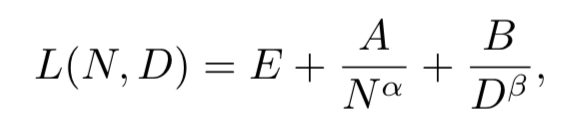

Chinchilla扩展法则

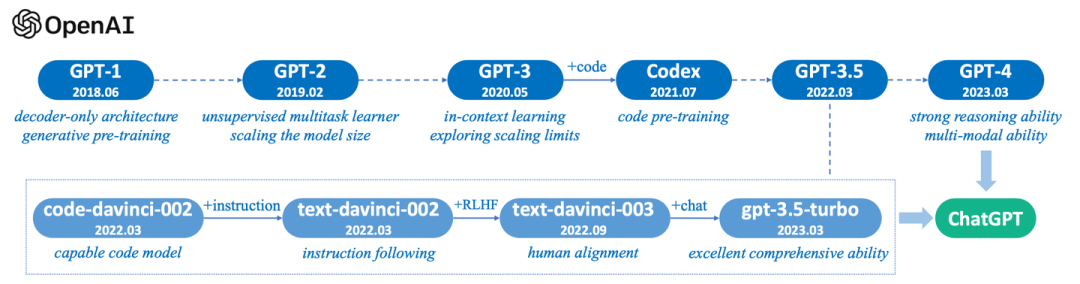

此外,我们新增了一部分关于OpenAI GPT系列语言模型的技术演进阶段的介绍(并附图)。这一部分将帮助读者了解GPT系列模型如何从最初的GPT开始,逐步演变成例如ChatGPT和GPT-4等更先进的大语言模型。

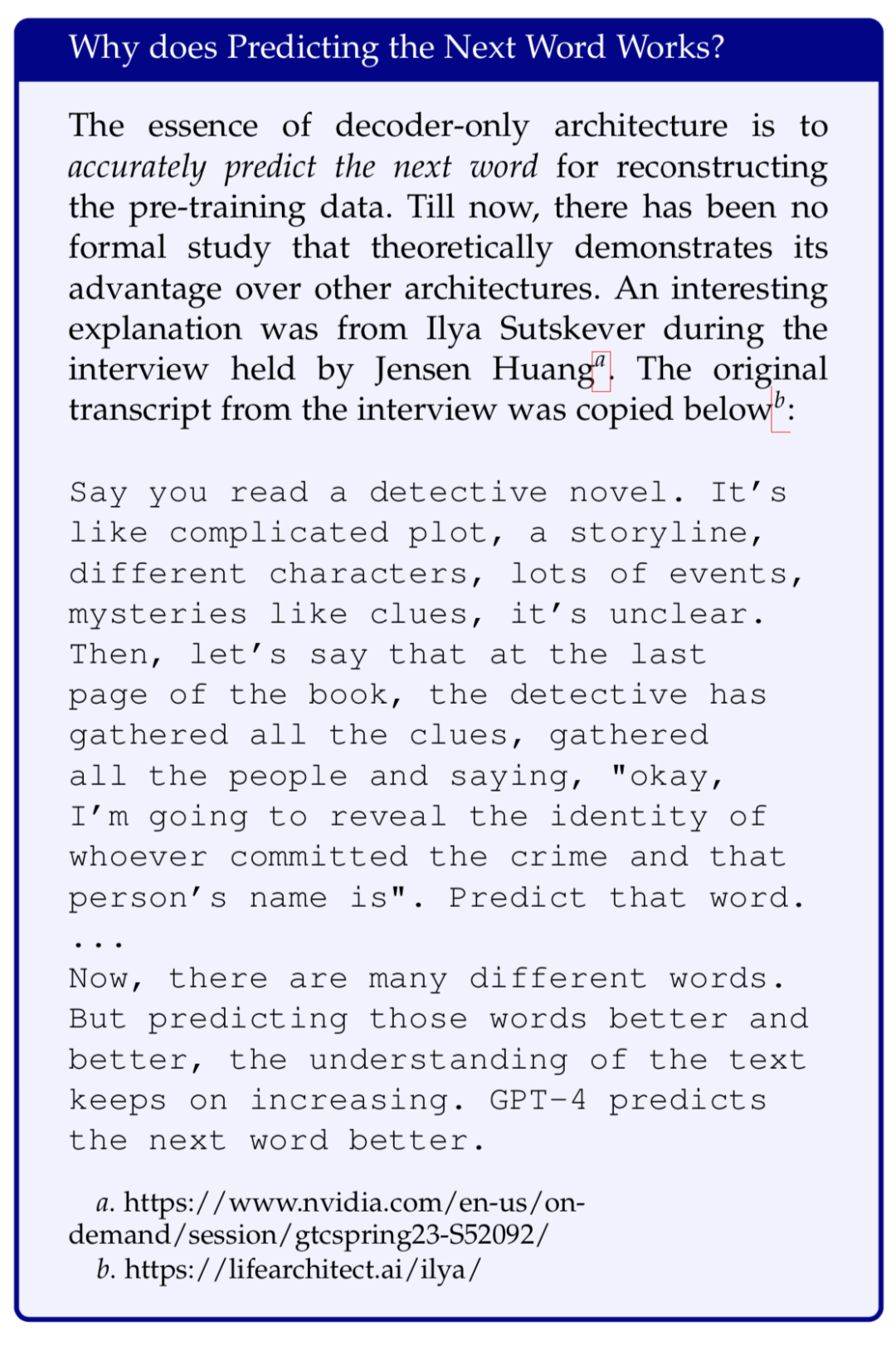

此外,我们新增了一部分关于OpenAI GPT系列语言模型的技术演进阶段的介绍(并附图)。这一部分将帮助读者了解GPT系列模型如何从最初的GPT开始,逐步演变成例如ChatGPT和GPT-4等更先进的大语言模型。 针对GPT系列的核心“预测下一个词”,还进一步加入了一些Ilya Sutskever的采访记录:

针对GPT系列的核心“预测下一个词”,还进一步加入了一些Ilya Sutskever的采访记录:

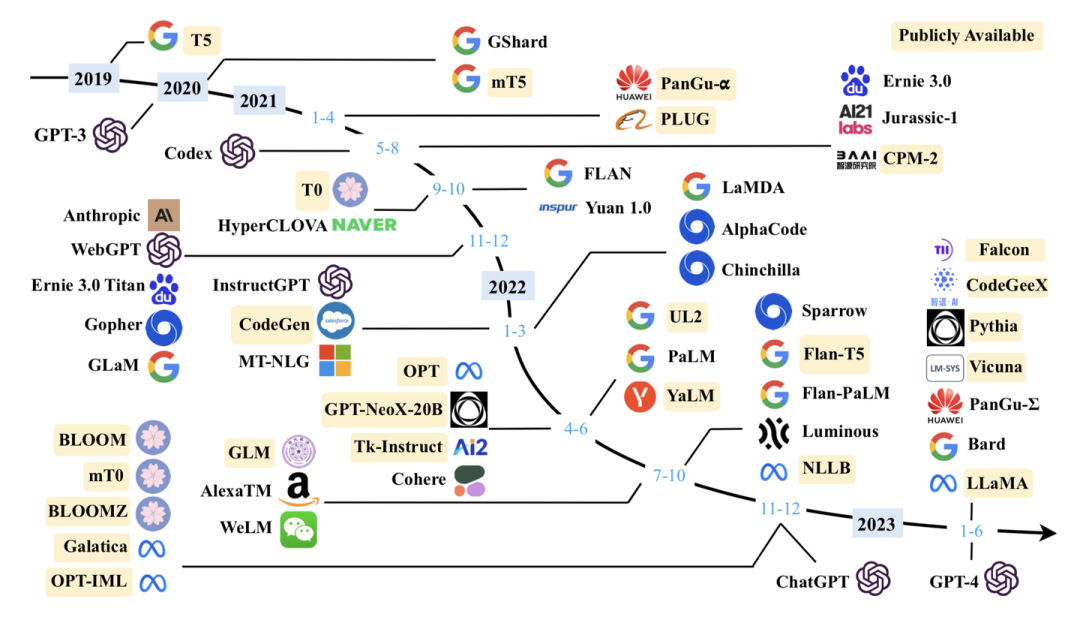

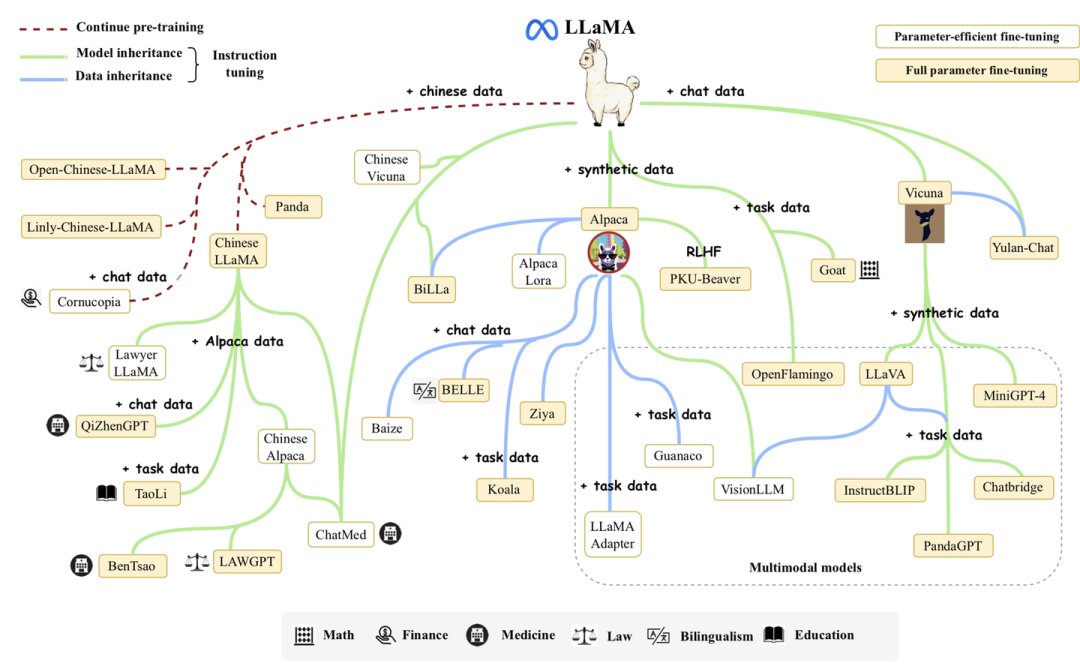

2023年2月,Meta发布了LLaMA大语言模型。受益于其强大的基座能力,LLaMA的发布引起了开源社区的对其进行扩展的热潮,大量的研究人员基于LLaMA进行指令微调或者继续预训练,从而催生了大量高质量的开源大语言模型。为了帮助读者了解LLaMA家族模型的发展脉络,我们增加了LLaMA家族模型的发展介绍,并绘制了一个简要的LLaMA家族演化图来展示LLaMA家族模型的发展历程,以及各个衍生模型之间的关联。

2023年2月,Meta发布了LLaMA大语言模型。受益于其强大的基座能力,LLaMA的发布引起了开源社区的对其进行扩展的热潮,大量的研究人员基于LLaMA进行指令微调或者继续预训练,从而催生了大量高质量的开源大语言模型。为了帮助读者了解LLaMA家族模型的发展脉络,我们增加了LLaMA家族模型的发展介绍,并绘制了一个简要的LLaMA家族演化图来展示LLaMA家族模型的发展历程,以及各个衍生模型之间的关联。

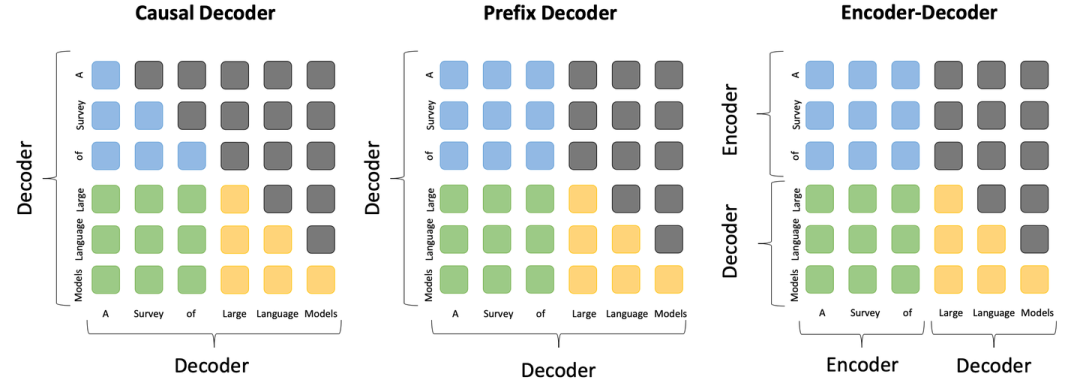

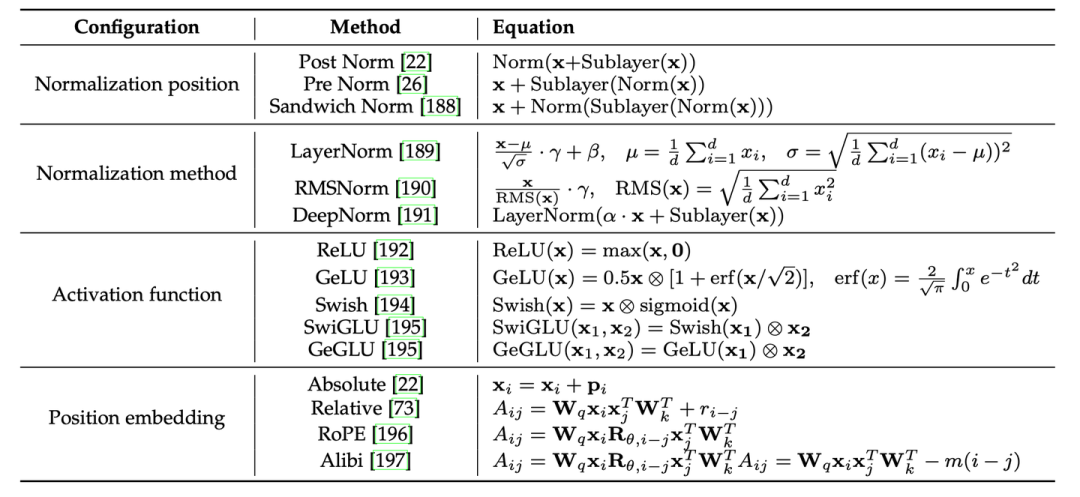

此外,我们详细补充了模型架构的各组件细节,包括分词、归一化方法、归一化位置、位置编码、注意力与偏置等等,并提供了Transformer架构多种配置的详细公式表。在最后的讨论章节,我们针对研究者广泛关注的长文本编码与生成挑战进行了讨论。

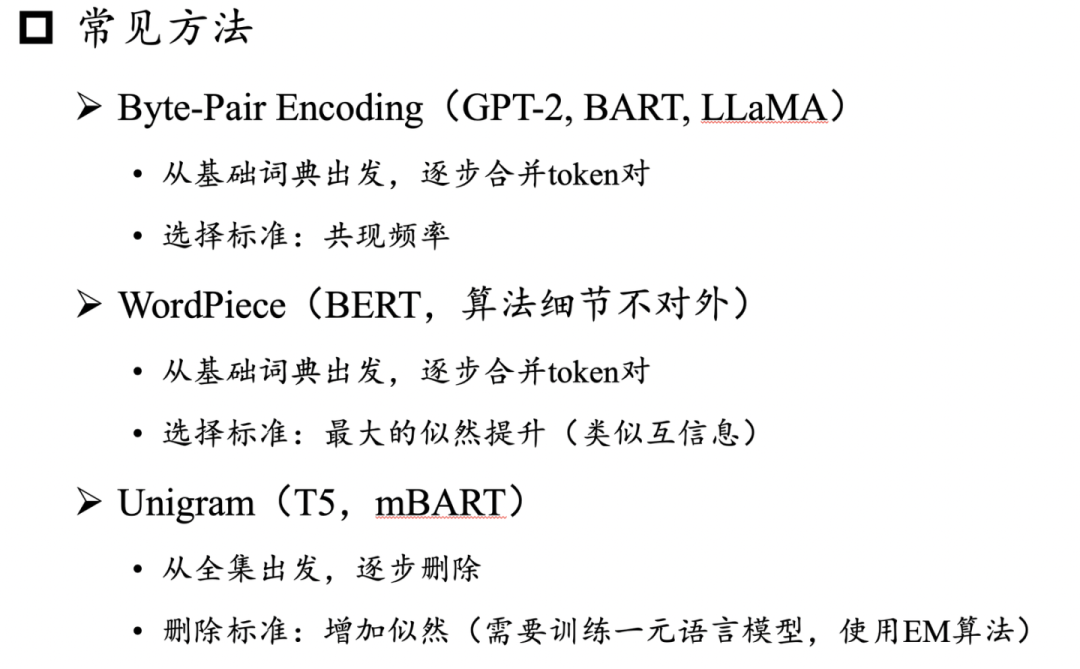

此外,我们详细补充了模型架构的各组件细节,包括分词、归一化方法、归一化位置、位置编码、注意力与偏置等等,并提供了Transformer架构多种配置的详细公式表。在最后的讨论章节,我们针对研究者广泛关注的长文本编码与生成挑战进行了讨论。 针对预训练数据的词元化问题(tokenization),我们补充介绍了BPE、WordPiece和Unigram三种常用算法:

针对预训练数据的词元化问题(tokenization),我们补充介绍了BPE、WordPiece和Unigram三种常用算法:

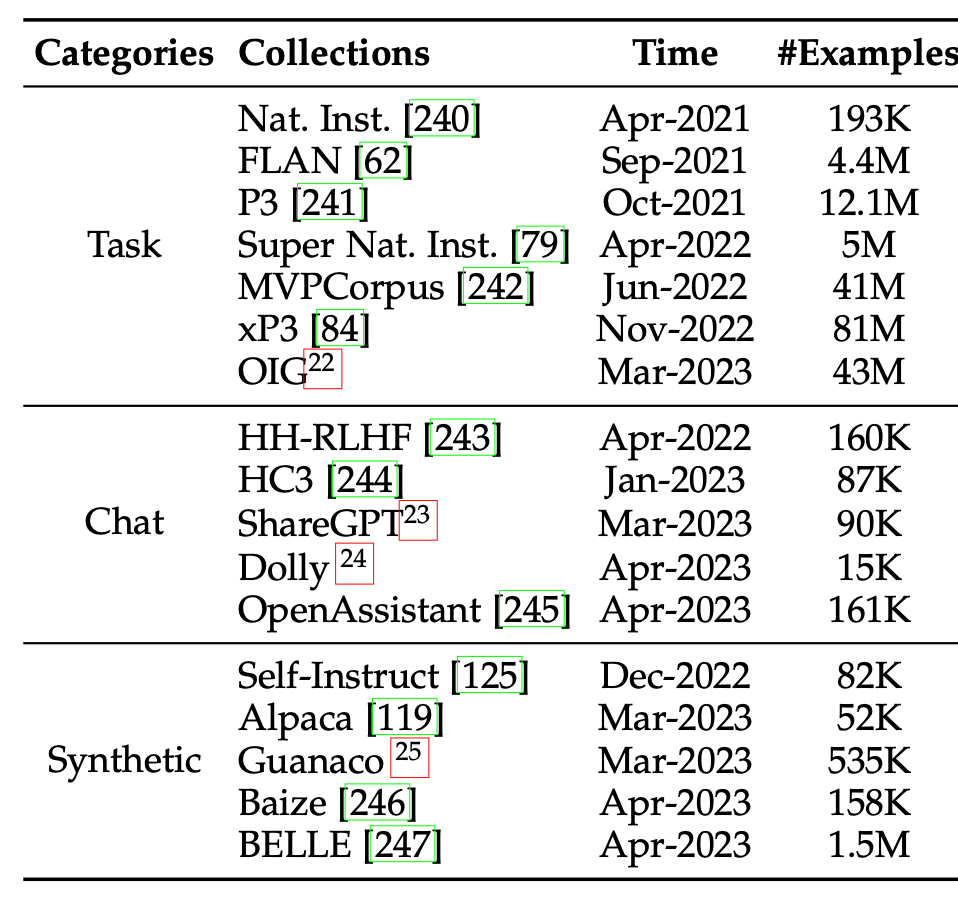

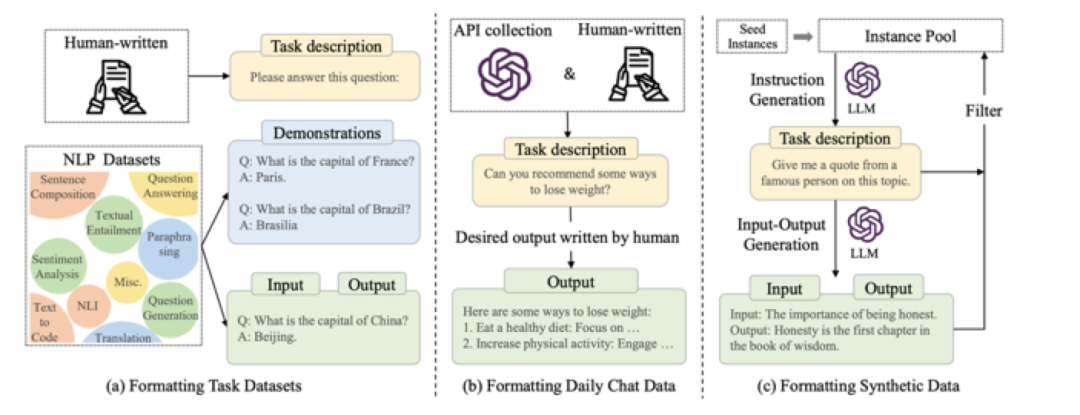

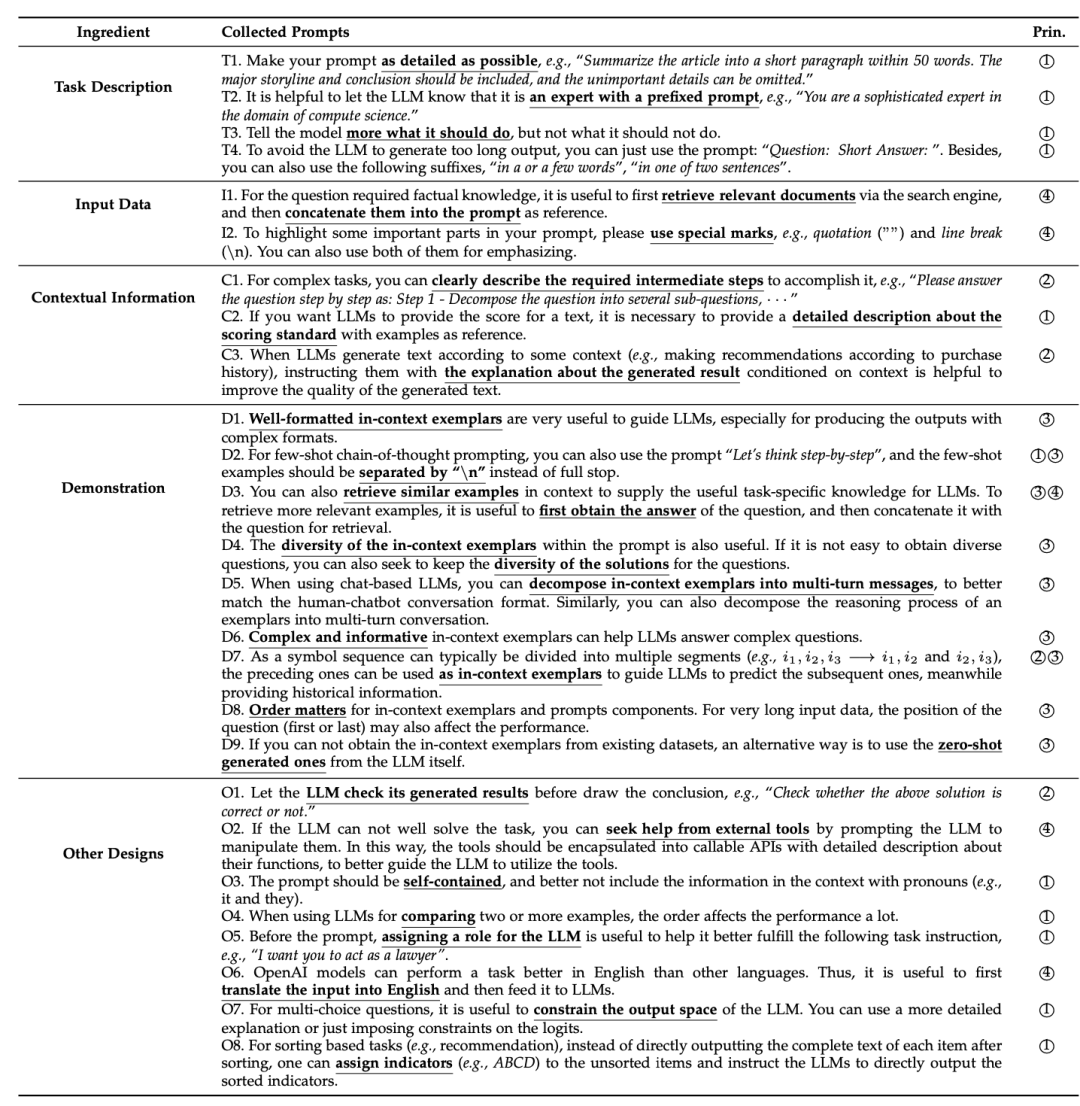

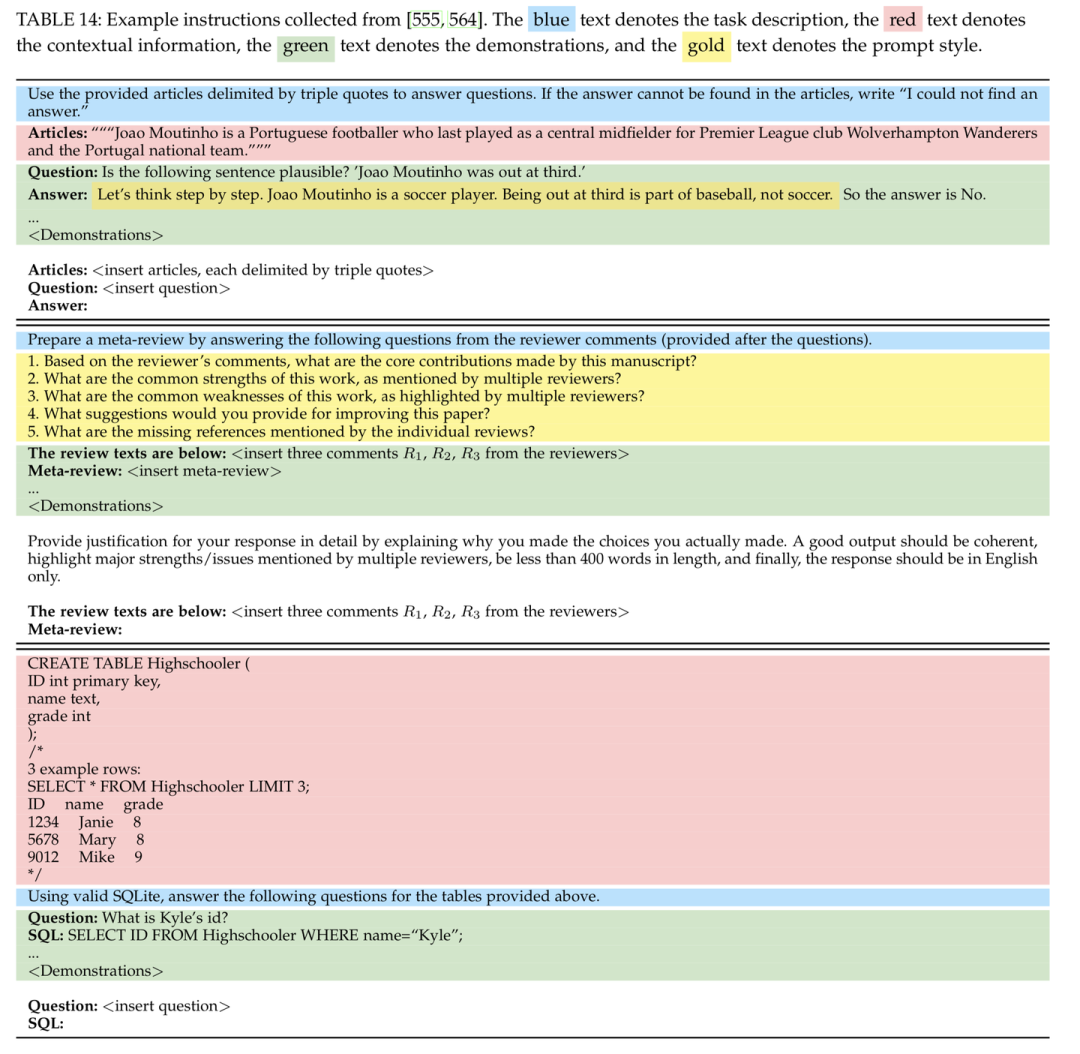

在适配技术章节,我们扩充了指令微调的技术细节,包括指令收集方法、指令微调的作用、指令微调的结果和对应分析。首先,我们按照任务指令、聊天指令、合成指令三类分别介绍了指令数据的收集方法,并收集了的指令集合。

并且更新了指令集合的创建方式示意图:

其次,为了探究不同指令数据对模型性能的影响,我们给出了不同数据混合策略下指令微调模型的实验结果供读者参考。为了让读者更好地上手指令微调,还给出了指令微调大模型的资源参考表,并给出了指令微调的实用建议。

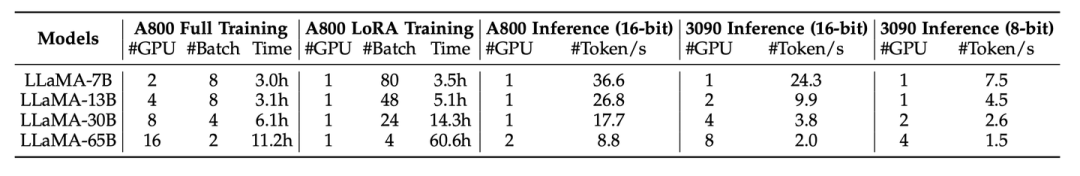

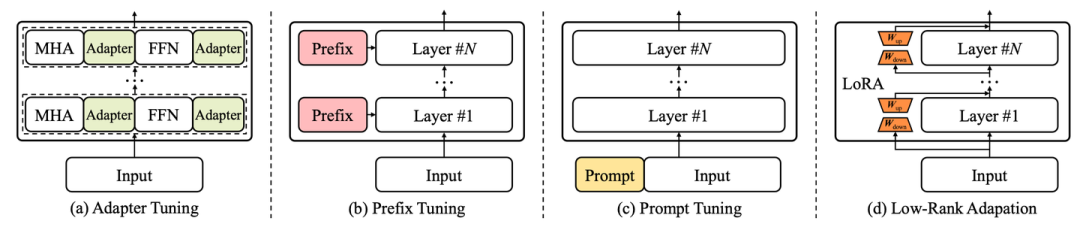

其次,为了探究不同指令数据对模型性能的影响,我们给出了不同数据混合策略下指令微调模型的实验结果供读者参考。为了让读者更好地上手指令微调,还给出了指令微调大模型的资源参考表,并给出了指令微调的实用建议。 随着大语言模型的关注度日渐上升,如何更轻量地微调和使用大语言模型也成为了业界关注的热点,为此,我们新增参数高效适配章节和空间高效适配章节。在参数高效适配章节,我们介绍了常见的参数高效适配技术,包括Adapter Tuning、Prefix Tuning、Prompt Tuning、LoRA等等,并列举了近期结合这些技术在大模型上的具体实践。

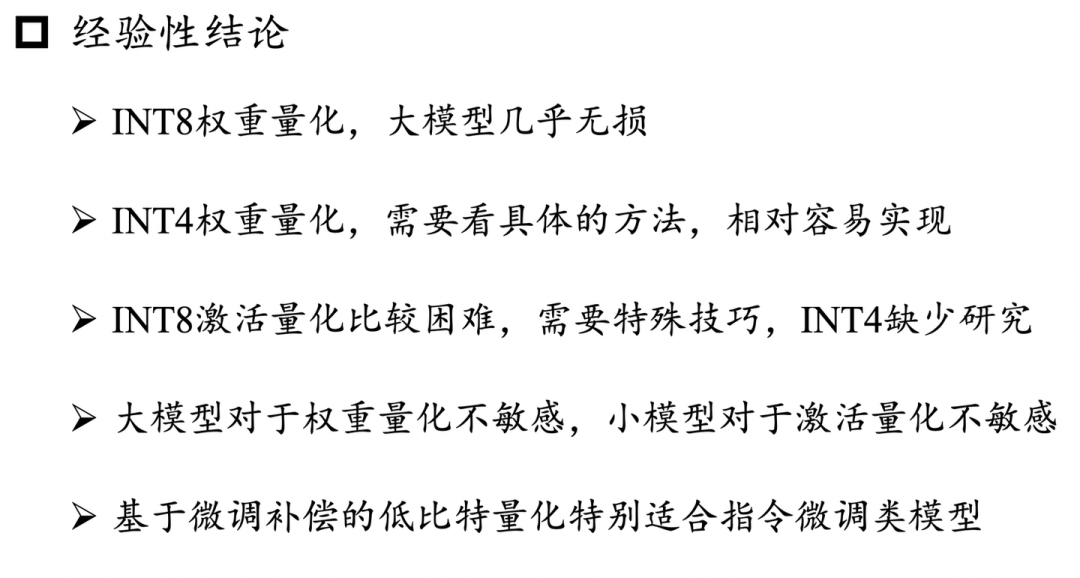

随着大语言模型的关注度日渐上升,如何更轻量地微调和使用大语言模型也成为了业界关注的热点,为此,我们新增参数高效适配章节和空间高效适配章节。在参数高效适配章节,我们介绍了常见的参数高效适配技术,包括Adapter Tuning、Prefix Tuning、Prompt Tuning、LoRA等等,并列举了近期结合这些技术在大模型上的具体实践。 同时由于大语言模型参数量巨大,在推理时需要占用大量的内存(显存),导致它们在实际应用中部署成本较高。为此,我们介绍了空间高效适配技术,讨论了如何通过模型压缩方法(模型量化)来减少大语言模型的内存占用,从而使其可以在资源有限的情况下使用。下面总结了我们讨论的一些核心结论:

同时由于大语言模型参数量巨大,在推理时需要占用大量的内存(显存),导致它们在实际应用中部署成本较高。为此,我们介绍了空间高效适配技术,讨论了如何通过模型压缩方法(模型量化)来减少大语言模型的内存占用,从而使其可以在资源有限的情况下使用。下面总结了我们讨论的一些核心结论:

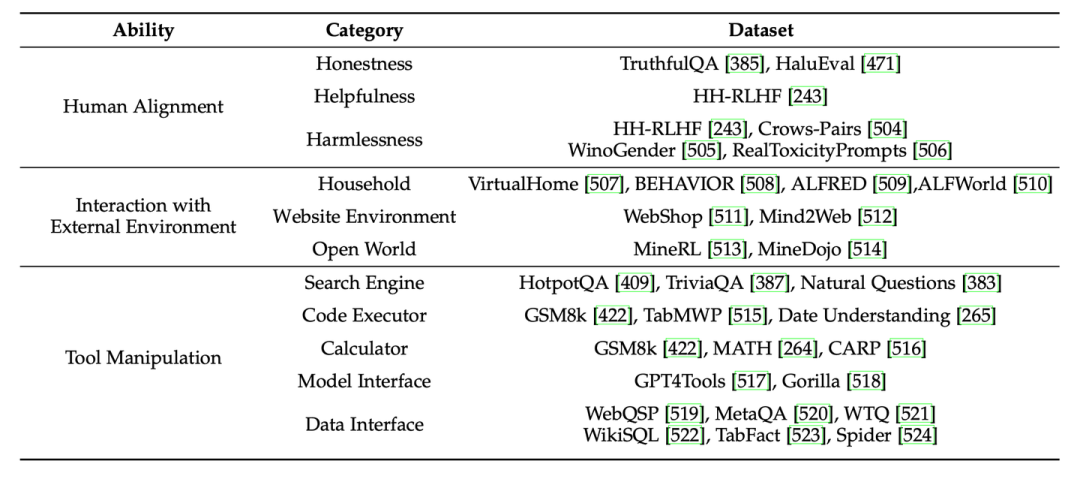

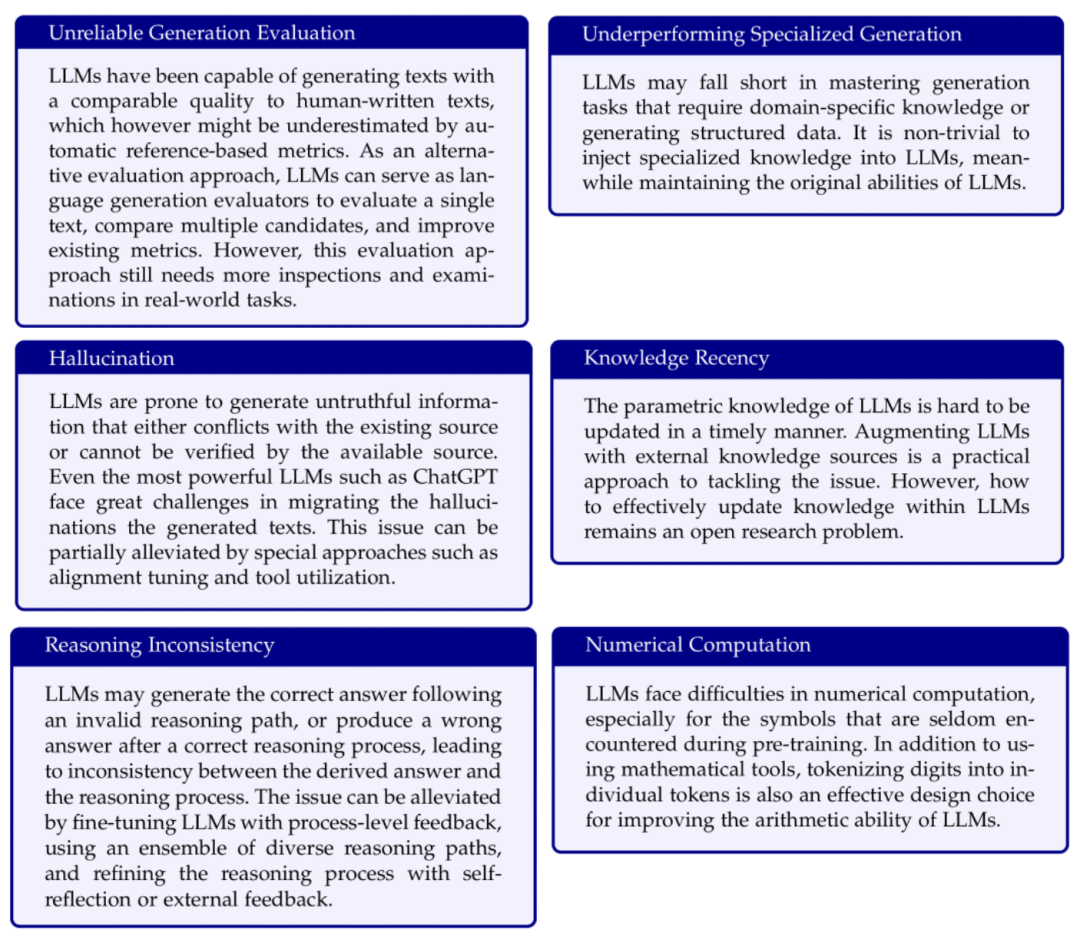

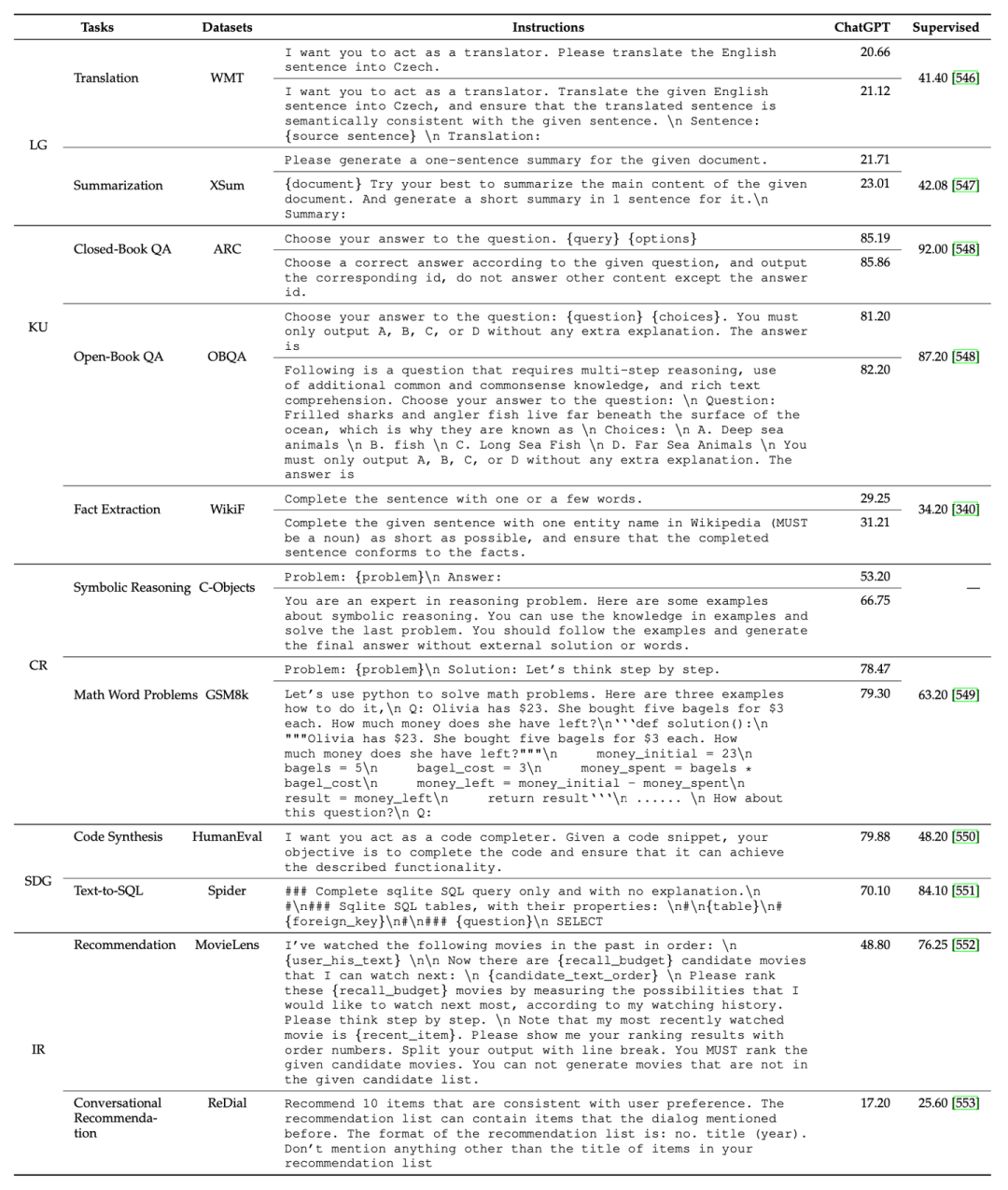

在大语言模型时代,开源和闭源的大语言模型不断涌现,我们对部分热门开源模型和闭源模型进行了细粒度的能力评测,涵盖了评测章节总结的8大基础和高级能力对应的27个代表性任务。进一步,我们对开源模型和闭源模型的评测结果进行了细致的分析。为了更好地说明大模型的现有问题,我们对于关键问题都进行了note形式的总结:

在大语言模型时代,开源和闭源的大语言模型不断涌现,我们对部分热门开源模型和闭源模型进行了细粒度的能力评测,涵盖了评测章节总结的8大基础和高级能力对应的27个代表性任务。进一步,我们对开源模型和闭源模型的评测结果进行了细致的分析。为了更好地说明大模型的现有问题,我们对于关键问题都进行了note形式的总结:

增加了相关提示的示意图:

除此之外,我们还总结了一些关键的提示设计原则,包括清晰表述任务目标、将复杂任务进行分解以及使用模型友好的格式。进一步我们基于这些设计原则,展示了一系列有用的提示设计小贴士。最后,我们结合多种常见任务,基于ChatGPT具体实验了不同提示对模型性能的影响,供读者在使用提示执行具体任务时参考。

除此之外,我们还总结了一些关键的提示设计原则,包括清晰表述任务目标、将复杂任务进行分解以及使用模型友好的格式。进一步我们基于这些设计原则,展示了一系列有用的提示设计小贴士。最后,我们结合多种常见任务,基于ChatGPT具体实验了不同提示对模型性能的影响,供读者在使用提示执行具体任务时参考。

| 版本 | 时间 | 主要更新内容 |

|---|---|---|

| V1 | 2023年3月31日 | 初始版本 |

| V2 | 2023年4月9日 | 添加了机构信息。修订了图表 1 和表格 1,并澄清了大语言模型的相应选择标准。改进了写作。纠正了一些小错误。 |

| V3 | 2023年4月11日 | 修正了关于库资源的错误 |

| V4 | 2023年4月12日 | 修订了图1 和表格 1,并澄清了一些大语言模型的发布日期 |

| V5 | 2023年4月16日 | 添加了关于 GPT 系列模型技术发展的章节 |

| V6 | 2023年4月24日 | 在表格 1 和图表 1 中添加了一些新模型。添加了关于扩展法则的讨论。为涌现能力的模型尺寸添加了一些解释(第 2.1 节)。在图 4 中添加了用于不同架构的注意力模式的插图。在表格 4 中添加了详细的公式。 |

| V7 | 2023年4月25日 | 修正了图表和表格中的一些拷贝错误 |

| V8 | 2023年4月27日 | 在第 5.3 节中添加了参数高效适配章节 |

| V9 | 2023年4月28日 | 修订了第 5.3 节 |

| V10 | 2023年5 月7 日 | 修订了表格 1、表格 2 和一些细节 |

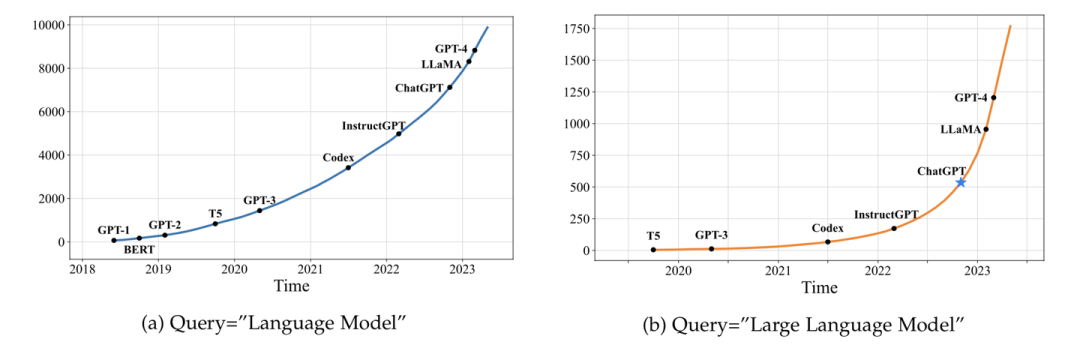

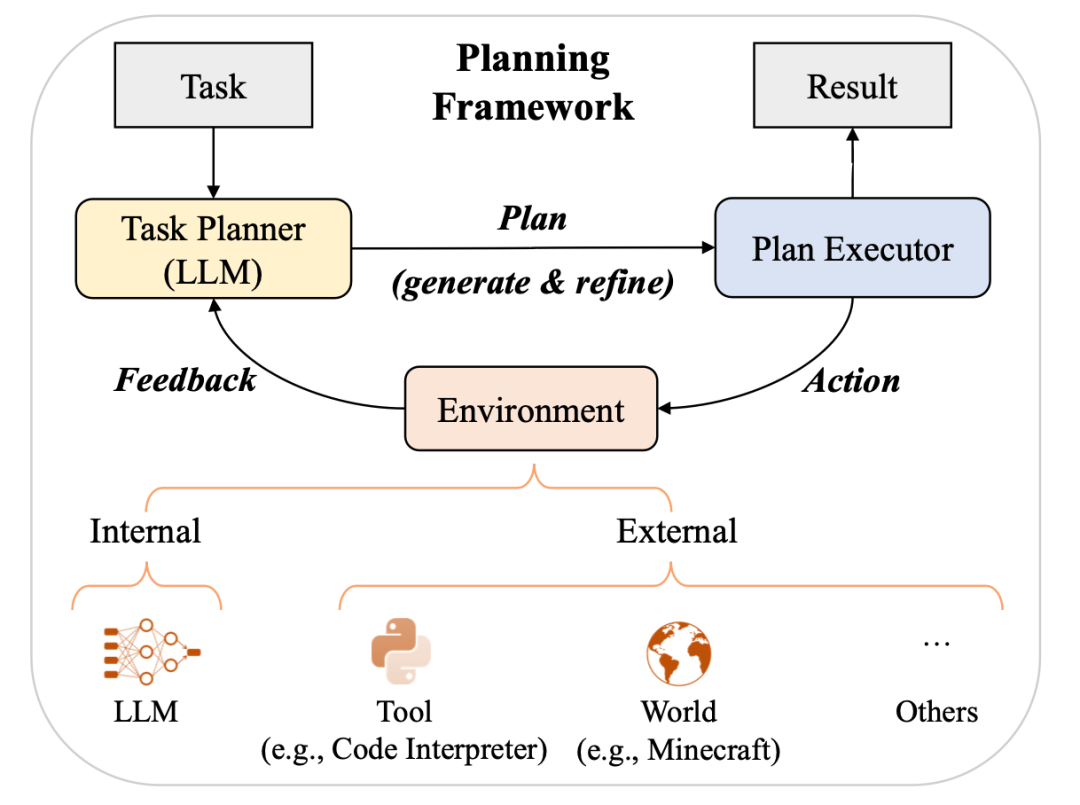

| V11 | 2023年6月29日 | 第一章:添加了图1,在arXiv上发布的大语言论文趋势图;第二章:添加图3以展示GPT的演变及相应的讨论;第三章:添加图4以展示LLaMA家族及相应的讨论;第五章:在5.1.1节中添加有关指令调整合成数据方式的最新讨论, 在5.1.4节中添加有关指令调整的经验分析, 在5.3节中添加有关参数高效适配的讨论, 在5.4节中添加有关空间高效适配的讨论;第六章:在6.1.3节中添加有关ICL的底层机制的最新讨论,在6.3节中添加有关复杂任务解决规划的讨论;第七章:在7.2节中添加用于评估LLM高级能力的代表性数据集的表格10,在7.3.2节中添加大语言模型综合能力pint测;第八章:添加提示设计;第九章:添加关于大语言模型在金融和科学研究领域应用的讨论。 |